人工智能技术开发人员应遵循的7条道德准则

随着人工智能技术的飞速发展,其对社会、经济乃至人类生活的深刻影响日益凸显。作为推动这一变革的核心力量,人工智能技术开发人员,尤其是从事基础软件开发的工程师与研究者,肩负着确保技术向善、造福人类的重要责任。因此,在构建智能未来的基石时,遵循明确的道德准则不仅是职业要求,更是时代赋予的使命。以下是在人工智能基础软件开发过程中,开发人员应恪守的七条核心道德准则。

1. 透明性与可解释性原则

人工智能系统,尤其是底层算法和模型,应尽可能具备透明性和可解释性。开发人员有责任使系统的决策逻辑能够被人类理解、审查和质疑。这意味着在设计和实现过程中,应记录数据来源、算法选择、模型训练过程以及关键参数,并努力开发使黑箱决策过程“白盒化”的工具和方法。透明是建立信任的基石,也是进行有效监管和问责的前提。

2. 公平性与无偏见准则

开发人员必须致力于识别和消除人工智能系统中的偏见,确保其决策对所有用户群体公平。这要求从数据采集的源头开始审视,警惕数据集中可能存在的历史性、社会性偏见。在算法设计阶段,应主动纳入公平性评估指标,并进行针对性的测试与校正,防止系统因种族、性别、年龄、地域等因素对个体产生不公正的待遇或歧视性结果。

3. 安全与可靠性准则

人工智能基础软件是上层应用的支柱,其安全与可靠性至关重要。开发人员必须将安全性融入开发全生命周期,确保系统能够抵御恶意攻击、对抗性样本的干扰,并在预期及非预期场景下保持鲁棒性和稳定性。系统应具备失效保护机制,在出现错误或失控时,能够安全降级或停止,避免造成不可控的物理伤害或社会危害。

4. 隐私保护与数据治理准则

人工智能的开发高度依赖数据。开发人员必须严格遵守数据隐私保护法律法规(如GDPR等),贯彻“隐私设计”理念。这意味着在系统架构之初,就应将数据最小化、匿名化、加密存储和访问控制等原则作为核心设计要素。开发者不仅是代码的编写者,更是用户数据的受托人,有责任建立清晰的数据使用协议,并确保数据在其整个生命周期内得到妥善治理。

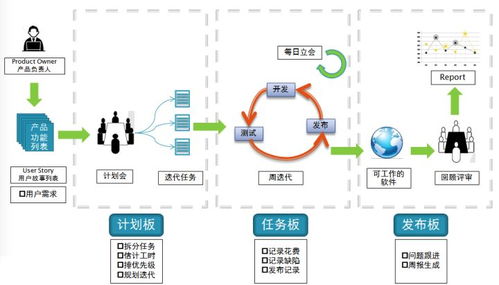

5. 责任与问责准则

明确的责任链条是人工智能伦理的关键。开发人员应清晰地界定自身在开发环节的责任,并与产品经理、测试人员、法务及最终部署方共同构建完整的问责体系。当人工智能系统产生不良后果时,应有机制追溯问题根源,无论是数据、算法、模型还是部署环境的问题,相关责任方都应能承担相应的技术、法律和道德责任。

6. 人类福祉与可控性准则

人工智能的发展终极目标应是增进人类福祉。开发人员应始终将“人类在环路中”作为重要设计原则,确保人类对关键决策保有最终的控制权和否决权。特别是在高风险领域(如医疗、交通、司法),系统应作为人类的辅助工具而非完全自主的决策者。开发过程应持续评估技术的社会影响,防止其被用于侵犯人权、加剧社会不平等或从事其他有悖于人类整体利益的活动。

7. 可持续发展与社会公益准则

人工智能的开发应考虑环境成本与社会效益。在基础软件层面,应致力于开发能效更高、计算资源需求更优的算法与框架,减少碳足迹。开发人员应积极思考如何利用自身技能解决社会面临的重大挑战,如气候变化、疾病防控、教育普惠等,并考虑将部分技术成果以开源、公益的形式共享,促进知识传播和技术普惠,避免技术鸿沟的进一步扩大。

****

上述七条准则并非孤立存在,而是相互关联、相辅相成的整体。在人工智能基础软件开发的复杂工程实践中,道德考量应与技术实现深度融合。它要求开发人员不仅具备卓越的技术能力,更需拥有深刻的人文关怀、社会洞察力和伦理反思习惯。通过构建在坚实伦理基础上的技术,我们才能引导人工智能走向一个真正安全、可信、公平且造福全人类的未来。这不仅是开发者的职业守则,更是我们对这个时代的一份庄严承诺。